Взаимоотношенията между хората и бизнесите в интернет пространството са в процес на тотално преобразяване заради майсторските фалшификати – умело манипулирани снимки и видеозаписи, в които лицата на хората биват изумително променени. Наричани още „дълбоки фейкове“, тези измами се използват за вредни политически кампании, фишинг и за злоупотреби с личните взаимоотношения.

Кой не би бил склонен да инвестира в криптовалута, за която Илън Мъск казва, че е перспективна? Преди седмица в Мрежата се завъртя такова видео. В него изглежда, че Мъск обяснява как платформа на име BitVex е обещаваща и си струва хората да вложат парите си, защото ще получават 30% възвръщаемост до края на живота си.

Видеото е фалшиво, оказа се после. Но в YouTube то е гледано 900 000 пъти, а в Twitter – 500 000 пъти. „Опа. Това категорично е съм аз“, коментира по повод фалшификата самият Мъск в профила си в социалната мрежа.

Финансови измами

Случаят с Мъск е просто най-пресният от множество майсторски фалшификати за финансови измами. Обикновено в тях се появява лицето на известен и успешен бизнесмен, богаташ, милиардер. Образът изглежда като да казва, че дадена инвестиция си струва и ще се отплати щедро.

В момента най-актуалната схема за „инвестиции“ са криптовалутите. Други финансови измами посредством майсторски фалшификати биха могли да експлоатират различни сценарии като например появата на известна ТВ звезда или спортна знаменитост в подкрепа на измамна дарителска кампания.

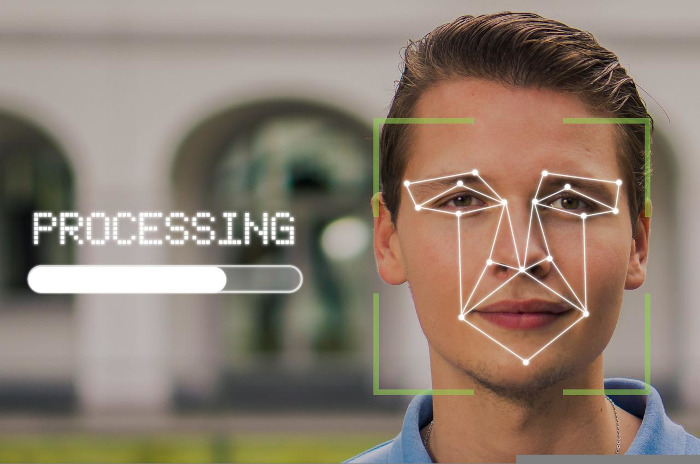

Специалисти предупреждават, че скоро трябва да очакваме и друга версия на т. нар. „дълбоки фейкове“. Става дума за използването на лицата на потребителите за достъп до банковите им ресурси и по-точно за преодоляване на защитата чрез лицево разпознаване. Доскоро считано за една от най-сигурните мерки за безопасност, лицевото разпознаване може лесно да бъде измамено чрез „дийпфейк“. Това бе установено в тест, проведен през май с участието на няколко банки и разработчици на AI системи. Те използваха лица, обработени или генерирани от алгоритъм с изкуствен интелект, в резултат на което се видя, че банковите защити лесно могат да бъдат подведени.

Фишинг чрез срещи и запознанства

Хората, които търсят партньори чрез интернет, ще трябва да станат много по-бдителни, предупреди преди броени дни доцент Касандра Крос, изследовател на интернет измами в школата QUT. Романтичните връзки също могат да са средство за финансови измами. Само в Австралия такива схеми са донесли на измамниците 131 милиона долара през 2020 г.

С течение на времето майсторските фалшификати в тази област вероятно ще станат по-трудни за откриване, тъй като извършителите започват използват AI за създаването на видеа и снимки, с които да измамят жертвите си.

„Кампаниите за предотвратяване на измами ще трябва да бъдат преразгледани, за да осведомят хората за този сложен и трудно откриваем метод на измама“, каза професор Крос. „AI и дълбоките фалшификати правят обратното търсене на изображения практически безполезно“.

В общия случай измамникът се представя за друго лице, което има потенциала да привлече интереса на потенциални партньори или партньорки. За да създаде фалшивата идентичност, престъпникът използва чужди снимки – например на офицер от военноморските сили или пък млада лекарка от престижна болница. Така се изгражда „лична история“ на привлекателен образ. „Например, американска жена е изпратила множество суми пари на мъж, за когото смятала, че е служител на ВМС на САЩ. Измамникът е манипулирал публично достъпни изображения и записи на американски военноморски офицер, за да създаде видеоклипове с фалшив образ и да изгради измамна идентичност“, казва Крос.

Политически кампании

Измами, очерняне, изнудване – това пък са целите на „майсторските фалшификати“ в сферата на политиката. Манипулираните снимки и видеозаписи могат да оформят общественото мнение, създава нагласи, да инициират социални конфликти и напрежение, дори да променят изборни резултати.

[related-posts]

В настоящата геополитическа ситуация това е особено привлекателна възможност. Например, през март в Мрежата се разпространи видео, в което изглеждаше, че украинският президент Володимир Зеленски нарежда на своите войници да се предадат. Всяко видео с привидното участие на някой от водещите световни политици, изказващ се по темата, може да предизвика промени у нагласите на обществата по цял свят.

Опитите за разпространяване на измамни видеа с участие на политически фигури не са новост. Една от първите жертви на подобни опити беше американският президент Барак Обама. След него и Доналд Тръмп бе обект на фалшификация.

Майсторските фалшификати са перфектно средство за реализиране на кампании за дезинформация, създавайки „новини“, на които мнозина могат лесно да повярват. Щетите – съсипана репутация, социални конфликти с човешки жертви – често пъти са дълготрайни и необратими.

Перспективи

Случващото се преобразява човешките взаимоотношения генерално, коментират анализаторите. Доверието във властите и медиите прогресивно се подкопава, създавайки атмосфера на недоверие. Има и други негативни ефекти: на фона на нарастващото разпространение на майсторски фалшификати политиците лесно биха могли и отричат вината във всеки нововъзникващ скандал.

По всяка вероятност не е далеч моментът, в който ще се заговори за въвеждането на ново законодателство или прилагането на съществуващи закони за санкциониране на създателите на дълбоки фейкове за фалшифициране на информация, засягаща други хора. Ще е нужен мултидисциплинарен подход с участието на колкото се може повече национални правителства и международни организации, както и частни компании, за да се потърси начин за защита на обществото от майсторски фалшифицираната „информация“.