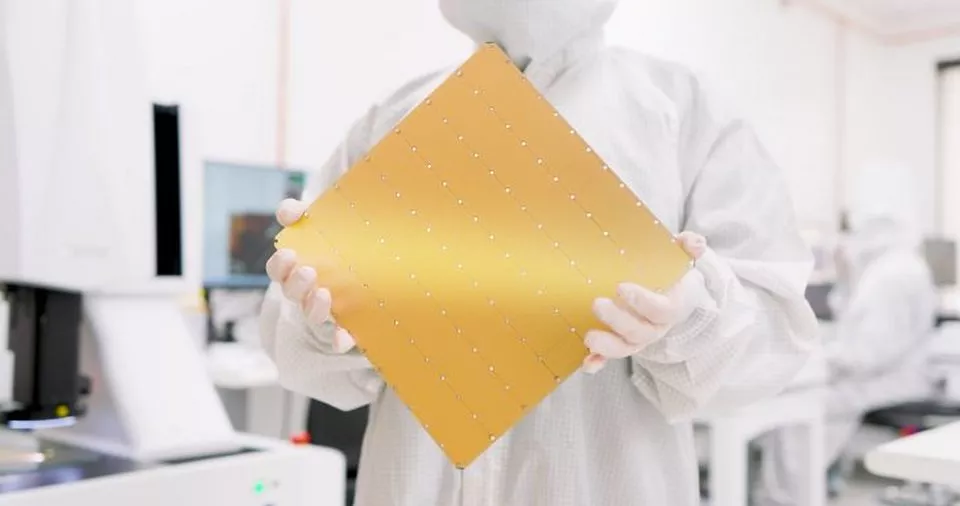

(снимка: Cerebras Systems)

Трето поколение чип WSE-3 на компанията Cerebras Systems идва с 900 000 оптимизирани за изкуствен интелект ядра, създадени да обучават AI модели с до 24 трилиона параметри. Това е най-големият AI чип на планетата, съдържащ трилиони транзистори.

Още с пускането на първия си чип Wafer Scale Engine (WSE), Cerebras бързо се придвижва напред и сега нейният процесор от трето поколение предлага невероятни спецификации, поради големия си размер, отбелязва WCCF Tech в публикация за разработката. Както подсказва името му, чипът е по същество цяла пластина от силиций и този път Cerebras залага на манията по AI с някои мощни спецификации:

- 4 трилиона транзистора;

- 900 000 AI ядра;

- 125 петафлопа върхова AI производителност;

- 44GB вградена SRAM памет;

- 5-нм TSMC процес;

- поддръжка на външна памет: 1,5TB, 12TB или 1,2PB;

- обучава AI модели с до 24 трилиона параметри;

- размер на клъстера до 2048 CS-3 системи.

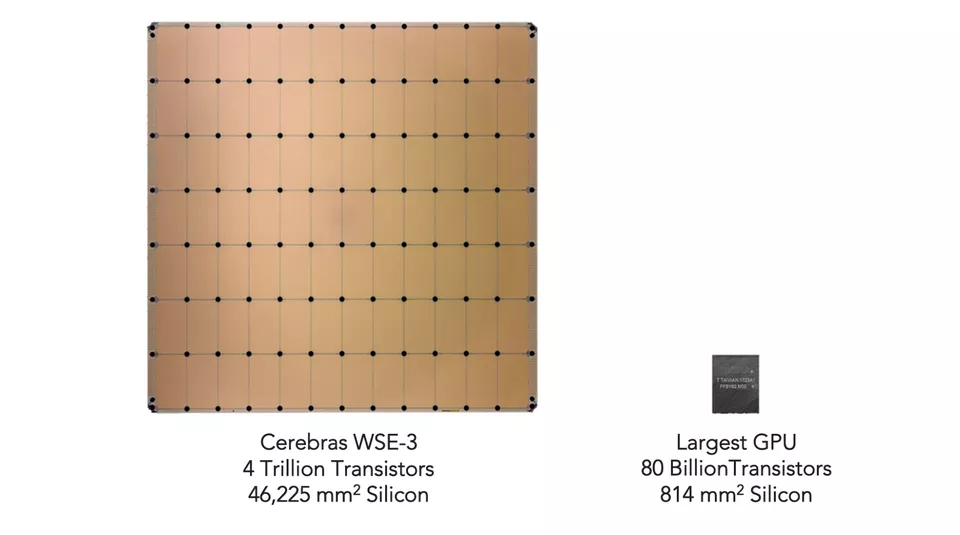

Самият чип WSE-3 има размер на матрицата от 46 225 мм², която е 57 пъти по-голяма от Nvidia H100, измерван с 826 мм². И двата чипа са базирани на 5-нанометров TSMC процес. H100 се счита за един от най-добрите AI чипове на пазара със своите 16 896 ядра и 528 тензорни ядра, но е по-малък от WSE-3, който включва 900 000 оптимизирани за AI ядра, или 52 пъти повече.

WSE-3 също има невероятни показатели за производителност – 21 петабайта в секунда пропускателна способност на паметта (7000 пъти повече от H100) и 214 петабита в секунда на Fabric (3715 пъти повече от H100). Чипът включва 44 GB вградена памет (880 пъти повече от H100).

В сравнение с WSE-2, новият WSE-3 предлага 2,25 пъти повече ядра (900 000 срещу 400 000), 2,4 пъти повече SRAM (44 GB срещу 18 GB) и много по-високи скорости на свързване, всички в рамките на същия размер на пакета. Освен това има 54% повече транзистори (4 трилиона срещу 2,6 трилиона).

(снимка: Cerebras Systems)

И така, каква е ползата от целия този хардуер? Е, чипът е проектиран първо за AI и предлага 125 PFlops върхова производителност. За сравнение, Nvidia H100 предлага около 3958 TFlops или около 4,0 PFlops пикова AI производителност, така че тук говорим за 31,25x увеличение.

Чипът се предлага и в набор от конфигурации с външна памет, вариращи от 1,5 TB, 12 TB и до 1,2 PB. С толкова много мощност в единствена матрица, чипът може да обучава AI модели с до 24 трилиона параметри.

В допълнение към WSE-3, Cerebras Systems обяви своята суперкомпютърна система CS-3 AI, която може да обучава модели, 10 пъти по-големи от GPT-4 и Gemini, благодарение на огромната си памет. CS-3 AI е проектиран както за корпоративни клиенти, така и за хиперскейлъри и осигурява много по-висока ефективност в сравнение със съвременните GPU.

64 от тези CS-3 AI системи ще бъдат използвани за захранване на суперкомпютъра Condor Galaxy 3, който ще предлага 8 екзафлопа изчислителна производителност за AI, удвоявайки производителността на системата при същата мощност и цена.

Celebris все още не е обявила цените и наличността на WSE-3 чиповете, но се очаква те да струват много по-малко от $25-$30K, които Nvidia иска за H100 GPU.