Защо са нужни социализирани системи за отговаряне на въпроси, след като имаме търсачката на Google? С този въпрос д-р Преслав Наков, ст.н.с. I ст. в Qatar Computing Research Institute, HBKU, започна маратона от лекции на „Astea Conference: Practical Magic” – събитие, организирано от Astea Solutions, което привлече специалисти от ИТ общността в Интер Експо Център – София.

Целта на подобни системи би могла да бъде получаване на отговори на сложни въпроси и постигане на взаимодействие, включително под формата на отговори на допълнителни въпроси. „Сега с такава задача не могат да се справят нито Google, нито Siri”, заяви Наков.

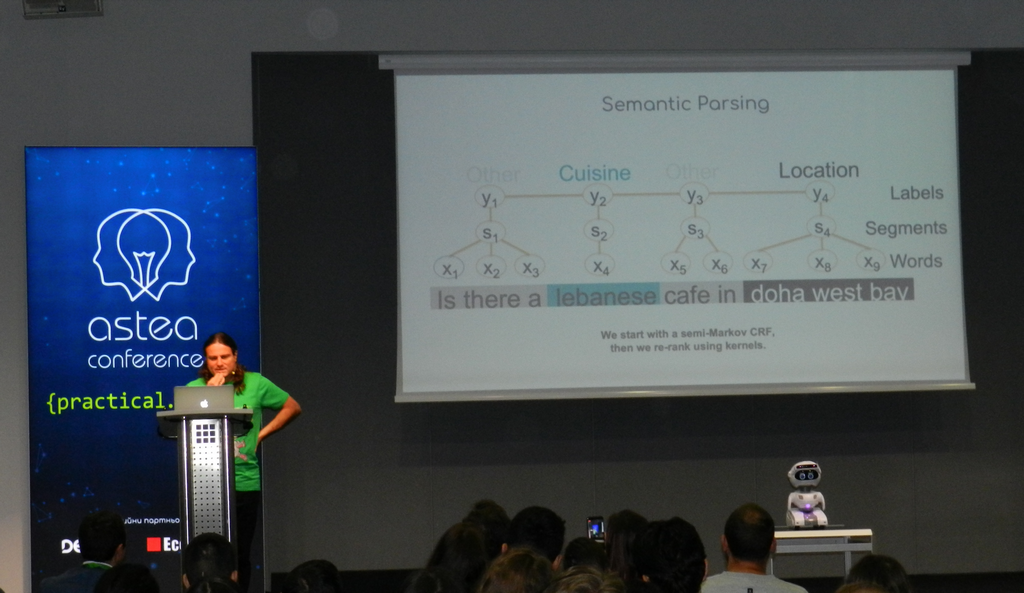

Неговият екип разработва система, която на базата на дълбоки невронни мрежи и семантично-синтактични ядра, интегрирани в реални системи, позволява извличане на информация от онлайн форуми, избор на добри отговори, откриване на сходни въпроси и намиране на отговор на нов въпрос. Системата е част от работата по проекта „Interactive sYstems for Answer Search” (IYAS), разработван в Qatar Computing Research Institute, HBKU в сътрудничество с Масачузетския технологичен институт (MIT).

Днес наблюдаваме тържество на слабото направление в изкуствения интелект над силното, сподели д-р Наков в интервю за TechNews.bg, като подчерта, че в момента сме на етапа машинно самообучение и все още далеч от истинския изкуствен интелект. Той говори също за бъдещето на чатбот решенията, което, по неговите думи, ще комбинира две системи – ориентирани към цел и диалогови.

Г-н Наков, какви са проблемите и предизвикателствата в машинното самообучение?

Един от проблемите е, че нямаме възможност да обясним резултатите на клиента. Всичко е една черна кутия и когато имаме грешка или правилно решение, е трудно да го обясним. Това е голям проблем при обработката на изображения. Ние можем да сменим един или два пиксела в дадено изображение и от тук нататък алгоритъмът да разпознава кучето не като куче, а като автобус. Последствията могат да са доста сериозни – например при автономните автомобили, ако се постави една малка лепенка на даден пътен знак, колата започва да го разпознава като съвсем друг пътен знак.

Друг голям проблем е, че всичко много зависи от данните. Алгоритмите са свързани с определени данни, което означава, че данните имат някакво „пристрастие”. Например, те са събрани само за определени американски градове или само сред студенти и т.н. И когато тези данни се използват в малко по-различна ситуация, нещата се „счупват”.

Отделно в данните може да има друг вид пристрастие, като например при автоматизираните интервюта за назначаване на работа и това кой ще бъде назначен. Ако по-голяма част от хората, които исторически са получавали дадена работа, са мъже, алгоритъмът ще предпочете мъже.

Как се преодоляват тези проблеми?

Това са проблеми, които се дискутират доста сериозно, включително на топ конференции за изкуствен интелект. Има много научни разработки по въпроса.

На някои места по света е законодателно невъзможно да се използват определени характеристики. Например, ако една банка взема решение да отпусне кредит, във въпросите е забранено да има такива за етническа принадлежност, раса, пол и др. Проблемът в случая е, че някои от тези атрибути са скрити в данните по друг начин и ние можем да ги предскажем – например по това къде живее човек, в кой квартал. Така че начинът за премахване на тези пристрастия не е съвсем ясен.

Някои от пристрастията са естествени. Ако човек иска да направи добър бизнес, той би взел определени решения, които може да не са честни за част от населението, но от бизнес гледна точка да са правилното решение. От тук нататък се влиза в конфликт със законодателното решение.

В някои държави се определя като незаконен даден вид дискриминация и това трябва да се заложи в алгоритъма. Разбира се, ние можем да го заложим, но вътре в данните и приложенията може да има изкривяване, защото същото законодателството не е било в сила преди.

Какво е бъдещето на чатбот системите?

В момента има прого „хайп” по тази тема. По принцип диалоговите системи се считаха за нещо маргинално допреди 5-6 години, поне в конференциите по компютърна лингвистика и разпознаване на говор. В момента обаче това е една много важна тема.

Още през 2016 г. Сатя Надела нарече чатботите „разговор като платформа” и приравни важността им за човечеството с тази на операционната система и уеб браузъра. Според други изказвания, бъдещето на потребителския интерфейс е… да няма интерфейс. Ние ще си говорим с телефона и с компютъра, с различни устройства. Но всъщност това е бъдещето – някакъв вид чатбот, някакъв вид диалогова система.

Вие как го виждате?

Има много изследвания в тази област, работи се активно. Аз лично го виждам като комбинация между две технологии. Едната е свързана с чатбота и начина, по който се реализира в комерсиалните системи, където имаме някаква цел, т.е. искаме да разберем какво се опитва да каже потребителят – например, доставка на храна, търсене на ресторант, комуникация с банка, потребителски съпорт и др. Това е нещо много специфично и ние се опитваме да разберем какво иска от нас потребителят. Подобни приложения са известни като „goal oriented” чатботове и се използват комерсиално – технологията работи и там има доста ръчно кодиране.

Другата област са чатботовете, които се учат директно от текста и генерират човешки разговор. При тях няма конкретна цел. Целта всъщност е да се поддържа разговор. Смесването на тези две технологии, според мен, е бъдещето – чатбот, който умее да води смислен разговор на различни теми и същевременно може да постигне нещо конкретно.

Застрашава ли ни изкуственият интелект?

И по тази тема има сериозен „хайп”. Някои световно известни личности, като Илон Мъск, Стивън Хокинг и Бил Гейтс, са сериозно загрижени от истинския изкуствен интелект. Но аз не мисля, че ние в момента сме там. Днес ние правим машинно самообучение – системи, които могат да решават добре конкретни задачи. Това, че една система може да разпознае какво има на една картинка, или може да поддържа смислен разговор, не означава, че тя наистина разбира какво се случва.

Сега наблюдаваме тържество на слабото направление в изкуствения интелект. Силното направление в ИИ иска да построим системи, които работят и мислят като човек, а слабото направление иска да построим системи, които могат да решават задачи, които решава и човекът, но не по същия начин.

Днес в машинното самообучение се опитваме да решаваме задачите по възможно най-добрия начин. Дали така ги решава и човекът, това не е важно и няма никакво значение.

5 коментара

Da podskazheme

Mashinata e mashina no i chovekat zhivotnite rasteniata sashto

Istinata e v govora

Mnogo slozhna sistema i ne razbiraema ot vsichki hora no ima i jora koito razbirat vseki detail ot tova

Чат ботовете са поредния маркетингов булшит. Чат ботове имаше преди 10 години и то пак базирани на невронни мрежи. Сега са по-лесно достъпни заради лесния достъп до изчислителни ресурси. Друг е въпросът дали трябва да се включват невронни алгоритми с несигурна надеждност, като имаше достатъчно добри текстови интерфейси, в които потребителя лесно може да избере възможност по редица други начини вместо да се опитва да напише правилния текст на чат бота, за да бъде разбран.